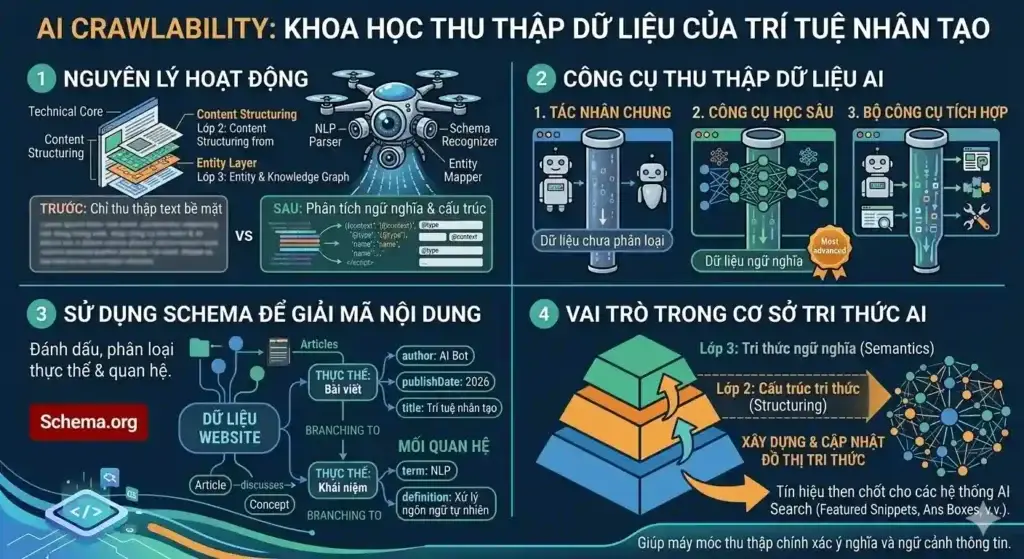

AI Crawlability (khả năng thu thập dữ liệu của AI) là khả năng các bot của hệ thống trí tuệ nhân tạo (như GPTBot, Google-Extended, ClaudeBot, DeepSeek Bot) truy cập, đọc và thu thập nội dung từ website của bạn một cách hiệu quả. Đây là yếu tố nền tảng trong VGEO Framework, thuộc Lớp 1: Data Accessibility, quyết định liệu nội dung của bạn có được các công cụ AI Search như ChatGPT, Gemini, Perplexity thu thập để sử dụng làm nguồn tri thức hay không. Tối ưu AI Crawlability bao gồm cấu hình robots.txt phù hợp, tốc độ tải trang nhanh, cấu trúc URL rõ ràng và sitemap được cập nhật thường xuyên.

Cấu trúc nội dung

Giới thiệu về AI Crawlability

Trong thế giới tìm kiếm truyền thống, các công cụ tìm kiếm như Google gửi “bot” (hay “spider”) đến website của bạn để thu thập dữ liệu. Bạn có thể kiểm soát chúng qua file robots.txt và các công cụ quản trị. Với sự bùng nổ của AI Search, một thế hệ bot mới đã xuất hiện: AI Crawlers – những con bot được thiết kế đặc biệt để thu thập dữ liệu cho các mô hình ngôn ngữ lớn (LLM) như ChatGPT, Gemini, Claude và Perplexity.

AI Crawlability không chỉ đơn giản là cho phép bot truy cập. Nó còn liên quan đến tốc độ, cấu trúc và khả năng bot hiểu được nội dung của bạn. Một website được tối ưu AI Crawlability tốt sẽ được các hệ thống AI thu thập thường xuyên hơn, từ đó tăng cơ hội xuất hiện trong câu trả lời của AI. Trong VGEO Framework, đây là bước đầu tiên và quan trọng nhất trong Lớp 1: Data Accessibility – nếu AI không thể truy cập, mọi nỗ lực tối ưu khác đều vô nghĩa.

AI Crawlability là gì?

AI Crawlability là tập hợp các yếu tố kỹ thuật ảnh hưởng đến khả năng các bot AI truy cập, đọc và thu thập nội dung từ website của bạn. Nó bao gồm:

- Cho phép truy cập: Cấu hình

robots.txtđể không chặn các AI bot quan trọng. - Tốc độ phản hồi: Thời gian server phản hồi yêu cầu của bot (TTFB – Time to First Byte).

- Khả năng đọc hiểu: Nội dung không bị chặn bởi JavaScript phức tạp, không yêu cầu đăng nhập.

- Cấu trúc liên kết: Bot có thể dễ dàng khám phá các trang khác qua liên kết nội bộ.

- Sitemap: File sitemap cung cấp cho bot bản đồ toàn bộ nội dung website.

Các AI bot phổ biến hiện nay bao gồm:

Tại sao AI Crawlability quan trọng?

1. Điều kiện tiên quyết cho GEO

Không có AI Crawlability, mọi nỗ lực tối ưu nội dung, xây dựng thực thể, hay tăng uy tín đều trở nên vô ích. Nếu AI bot không thể truy cập website, nội dung của bạn sẽ không bao giờ được đưa vào cơ sở dữ liệu của các mô hình ngôn ngữ lớn.

2. Tăng cường hiện diện trong AI Search

Các hệ thống AI như ChatGPT, Perplexity ngày càng dựa vào dữ liệu web thời gian thực. Website được crawl thường xuyên sẽ có cơ hội xuất hiện trong các câu trả lời nhanh hơn và chính xác hơn.

3. Ảnh hưởng đến các yếu tố khác

Tốc độ crawl và tần suất cập nhật từ AI bot ảnh hưởng đến việc nội dung mới của bạn có nhanh chóng được AI biết đến hay không. Một website có cấu trúc tốt sẽ được crawl thường xuyên hơn.

4. Đo lường hiệu quả GEO

Trong VGEO Framework, AI Crawlability là yếu tố đầu tiên (A1) trong nhóm 20 yếu tố, được đo lường qua tỷ lệ bot truy cập thành công, thời gian phản hồi và các lỗi crawl.

📌 Lưu ý từ VGEO Framework

AI Crawlability không chỉ là kỹ thuật mà còn là chiến lược. Bạn cần chủ động “mời” các AI bot đến website của mình bằng cách cung cấp nội dung giá trị, cập nhật thường xuyên và tối ưu trải nghiệm crawl.

Các yếu tố ảnh hưởng đến AI Crawlability

1. Cấu hình robots.txt

File robots.txt là nơi đầu tiên bot kiểm tra trước khi vào website. Cần đảm bảo rằng các AI bot quan trọng không bị chặn. Ví dụ cấu hình tối ưu cho cuonggeo.com:

User-agent: GPTBot Allow: / Disallow: /wp-admin/ User-agent: Google-Extended Allow: / User-agent: ClaudeBot Allow: / User-agent: DeepSeek Bot Allow: / User-agent: PerplexityBot Allow: / User-agent: CCBot Allow: / Sitemap: https://cuonggeo.com/sitemap_index.xml

2. Tốc độ tải trang (Page Speed)

AI bot có thời gian chờ giới hạn. Nếu website của bạn tải chậm, bot có thể bỏ qua. Tối ưu TTFB (Time to First Byte) dưới 200ms, LCP dưới 2.5s.

3. Cấu trúc URL và liên kết nội bộ

- URL thân thiện, dễ hiểu (ví dụ:

/entity/ai-crawlability). - Liên kết nội bộ logic giúp bot khám phá các trang sâu hơn.

- Tránh các liên kết hỏng (404) làm lãng phí ngân sách crawl.

4. Sitemap

Sitemap cung cấp cho bot danh sách tất cả các trang quan trọng. Nên có nhiều sitemap phân loại:

sitemap-pages.xml: các trang tĩnh (About, Services…)sitemap-articles.xml: bài viết blog, nghiên cứusitemap-entities.xml: các trang thực thểsitemap-news.xml: tin tức cập nhật

5. Khả năng đọc JavaScript

Một số AI bot có thể đọc nội dung được render bằng JavaScript, nhưng không phải bot nào cũng làm tốt. Để an toàn, nội dung quan trọng nên được hiển thị dưới dạng HTML tĩnh hoặc có cơ chế fallback.

6. Tránh các rào cản khác

- Không yêu cầu đăng nhập để xem nội dung.

- Không sử dụng CAPTCHA quá mức.

- Tránh chuyển hướng (redirect) phức tạp.

So sánh Crawlability truyền thống và AI Crawlability

Kiểm tra AI Crawlability cho website của bạn

Công cụ kiểm tra

- Google Search Console: Báo cáo “Nhật ký thu thập dữ liệu” cho thấy hoạt động của Googlebot và Google-Extended.

- Log file phân tích: Xem trực tiếp từ server log để biết bot nào đã ghé thăm, tần suất, và lỗi.

- Công cụ kiểm tra robots.txt: Dùng trong Search Console hoặc các trang như “robots.txt tester”.

- User-Agent simulator: Mô phỏng cách bot nhìn thấy website (ví dụ: công cụ “Fetch as Google” nhưng cho AI bot thì ít có).

Các chỉ số cần theo dõi

- Tỷ lệ bot truy cập thành công: Số lượng request 2xx so với tổng số.

- Thời gian phản hồi trung bình: Nên dưới 500ms.

- Số trang được crawl mỗi ngày: Xu hướng tăng cho thấy website được quan tâm.

- Lỗi 4xx/5xx: Càng ít càng tốt.

Thực hành tối ưu AI Crawlability trên cuonggeo.com

Website của chúng ta đã áp dụng nhiều biện pháp:

- robots.txt: Cấu hình cho phép tất cả AI bot quan trọng (xem ví dụ trên).

- Sitemap: Dùng Rank Math để tạo sitemap động, bao gồm riêng cho thực thể (entity).

- Tốc độ: Tối ưu với plugin cache, CDN, hình ảnh nén.

- Cấu trúc URL: Đẹp, rõ ràng, không tham số.

- Nội dung: Các bài viết thực thể được cập nhật thường xuyên, giữ cho website luôn “sống”.

📌 CHECKLIST AI CRAWLABILITY

- ✅ Cho phép GPTBot, Google-Extended, ClaudeBot, DeepSeek Bot, PerplexityBot, CCBot trong robots.txt

- ✅ Tối ưu TTFB dưới 200ms

- ✅ Có sitemap cập nhật, gửi lên Search Console

- ✅ URL thân thiện, không chứa tham số lạ

- ✅ Không chặn nội dung bằng JavaScript quan trọng

- ✅ Tránh liên kết hỏng (404)

- ✅ Theo dõi log server hàng tháng

Kết luận

AI Crawlability là nền tảng của mọi chiến lược GEO. Không có nó, website của bạn sẽ “vô hình” trước các hệ thống AI. Trong VGEO Framework, đây là yếu tố đầu tiên cần kiểm tra và tối ưu. Bằng cách cấu hình đúng robots.txt, tăng tốc website, và cung cấp sitemap chất lượng, bạn đảm bảo rằng nội dung của mình có cơ hội được các AI bot khám phá và đưa vào kho tri thức toàn cầu.

Hãy bắt đầu bằng cách kiểm tra file robots.txt và tốc độ website của bạn ngay hôm nay. Khám phá thêm các thực thể liên quan như Structured Data, AI Indexability và VGEO Framework.

Câu hỏi thường gặp (FAQ) về AI Crawlability

1. Làm thế nào để biết AI bot đã truy cập website của tôi?

Bạn có thể kiểm tra log file server (nếu được cấp quyền) hoặc sử dụng các plugin WordPress như “AI Crawler Detector”. Một số dịch vụ phân tích log cũng có thể giúp. Trong Google Search Console, bạn có thể thấy hoạt động của Google-Extended.

2. Có nên chặn một số AI bot không?

Chỉ nên chặn nếu bạn có lý do chính đáng (ví dụ: bot tiêu tốn tài nguyên quá mức). Tuy nhiên, hãy cân nhắc kỹ vì việc chặn có thể làm giảm cơ hội xuất hiện trong AI Search. Với hầu hết website, nên cho phép tất cả AI bot.

3. Tốc độ website ảnh hưởng thế nào đến AI crawl?

AI bot cũng có thời gian chờ. Nếu website quá chậm, bot có thể bỏ qua và không thu thập dữ liệu. Tốc độ tối ưu giúp bot hoàn thành công việc nhanh hơn và quay lại thường xuyên hơn.

4. Sitemap có thực sự cần thiết cho AI bot không?

Có. Sitemap giúp bot khám phá các trang mới và quan trọng một cách hiệu quả. Nên có sitemap riêng cho từng loại nội dung (bài viết, thực thể, tin tức) để bot dễ dàng xác định ưu tiên.

5. AI Crawlability khác gì với Indexability?

Crawlability là khả năng bot truy cập và đọc nội dung. Indexability là khả năng nội dung được lưu vào cơ sở dữ liệu của AI và sẵn sàng để truy xuất. Crawlability là bước đầu tiên; indexability là bước tiếp theo. Cả hai đều quan trọng trong VGEO.

Bài viết thuộc hệ thống thực thể của VGEO Framework – Bản quyền © 2026 Nguyễn Đình Cường.

Cập nhật lần cuối: 18/03/2026.