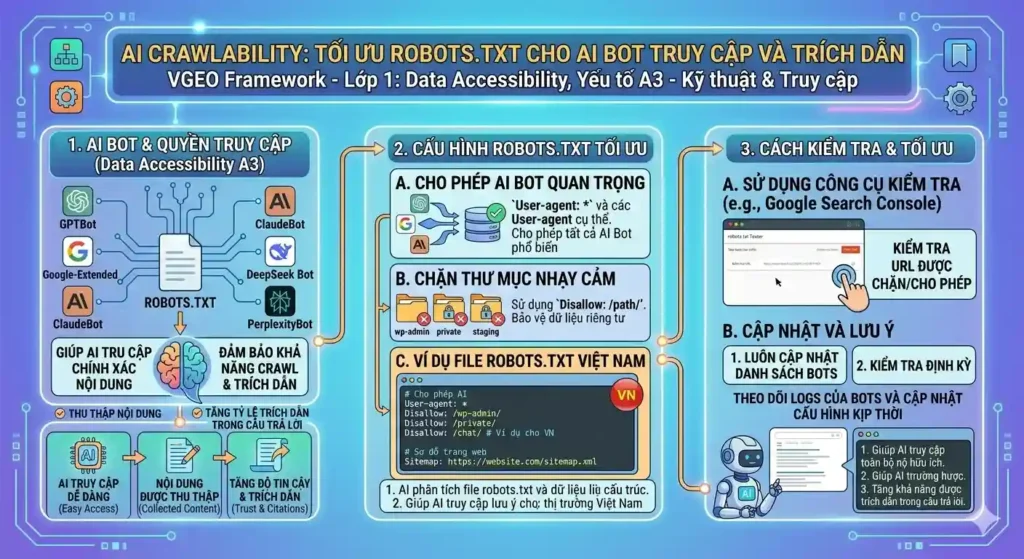

AI Crawlability là khả năng các bot của hệ thống AI (GPTBot, Google-Extended, ClaudeBot, DeepSeek Bot, PerplexityBot) truy cập và đọc nội dung website của bạn. Cấu hình robots.txt đúng cách là yếu tố đầu tiên và quan trọng nhất trong Lớp 1: Data Accessibility của VGEO Framework.

Một file robots.txt tối ưu phải cho phép tất cả các bot AI quan trọng, đồng thời chặn các thư mục nhạy cảm (wp-admin, private). Bài viết này hướng dẫn chi tiết cách cấu hình, kèm ví dụ cụ thể và các lưu ý dành cho thị trường Việt Nam, giúp bạn đảm bảo AI bot có thể thu thập nội dung, từ đó tăng khả năng được trích dẫn trong câu trả lời của ChatGPT, Gemini, Perplexity.

Cấu trúc nội dung

Mở đầu: Tại sao AI Crawlability là bước đầu tiên của GEO?

Trong thế giới SEO truyền thống, bạn đã quen với việc cấu hình robots.txt để hướng dẫn Googlebot. Nhưng với sự phát triển của AI Search, bạn cần quan tâm đến một loạt các “bot” mới: GPTBot (OpenAI), Google-Extended (Google AI), ClaudeBot (Anthropic), DeepSeek Bot (DeepSeek), PerplexityBot (Perplexity). Nếu các bot này bị chặn, nội dung của bạn sẽ không bao giờ xuất hiện trong câu trả lời của ChatGPT, Gemini, hay Perplexity – bất kể bạn có tối ưu nội dung đến đâu.

AI Crawlability là yếu tố đầu tiên (A1) trong 20 yếu tố của VGEO Framework, thuộc Lớp 1: Data Accessibility. Nó quyết định liệu các hệ thống AI có thể đọc website của bạn hay không. Bài viết này sẽ hướng dẫn bạn cấu hình robots.txt một cách tối ưu, kèm theo giải thích chi tiết và các lưu ý quan trọng.

Các AI bot quan trọng cần cho phép

Dưới đây là danh sách các bot AI phổ biến mà bạn nên cho phép trong robots.txt, cùng với user-agent tương ứng:

Bạn có thể kiểm tra log server để biết bot nào thường xuyên truy cập website của mình, từ đó ưu tiên cấu hình.

Cấu hình robots.txt tối ưu cho AI bot

Dưới đây là mẫu robots.txt hoàn chỉnh, có thể áp dụng cho hầu hết các website WordPress (điều chỉnh các đường dẫn chặn phù hợp với cấu trúc của bạn).

# robots.txt cho website cuonggeo.com (ví dụ) User-agent: * Allow: / Disallow: /wp-admin/ Disallow: /wp-includes/ Disallow: /wp-content/plugins/ Disallow: /wp-content/cache/ Disallow: /private/ Disallow: /draft/ # Cho phép các AI bot chính User-agent: GPTBot Allow: / Disallow: /wp-admin/ Disallow: /private/ User-agent: Google-Extended Allow: / User-agent: ClaudeBot Allow: / User-agent: DeepSeek Bot Allow: / User-agent: PerplexityBot Allow: / # Các bot tìm kiếm truyền thống vẫn cần thiết User-agent: Googlebot Allow: / User-agent: Bingbot Allow: / # Sitemap Sitemap: https://cuonggeo.com/sitemap_index.xml

Giải thích từng phần:

- User-agent: * – Quy tắc chung cho tất cả bot. Cho phép truy cập toàn bộ, nhưng chặn các thư mục không cần thiết (wp-admin, wp-includes, cache, private, draft).

- User-agent: GPTBot, Google-Extended, … – Các quy tắc riêng cho từng bot AI. Với GPTBot, chúng ta cho phép truy cập mọi nơi ngoại trừ các khu vực nhạy cảm (wp-admin, private). Với Google-Extended, cho phép toàn bộ (có thể tùy chỉnh nếu muốn). Với các bot khác, tương tự.

- User-agent: Googlebot, Bingbot – Vẫn giữ để hỗ trợ SEO truyền thống.

- Sitemap – Khai báo đường dẫn sitemap để bot dễ dàng tìm thấy nội dung.

Lưu ý: Nếu bạn sử dụng WordPress, thư mục /wp-admin/ và /wp-includes/ nên bị chặn để tiết kiệm “crawl budget”. Các thư mục như /private/ hay /draft/ nếu có cũng nên chặn.

Kiểm tra và xác minh

Sau khi cập nhật robots.txt, bạn cần kiểm tra để đảm bảo không có lỗi và các bot AI đã được phép:

- Kiểm tra cú pháp: Truy cập

https://cuonggeo.com/robots.txttrên trình duyệt để xem file có hiển thị đúng nội dung không. - Dùng Google Search Console: Vào mục “Cài đặt” → “Tệp robots.txt” để kiểm tra và gửi yêu cầu kiểm tra. Google sẽ thông báo lỗi nếu có.

- Theo dõi log server: Xem log để biết các bot AI có thực sự truy cập và không gặp lỗi 403 (Forbidden) hay 404 (Not Found). Bạn có thể dùng plugin WordPress như “WP Log Viewer” hoặc xem log qua hosting.

- Kiểm tra với công cụ mô phỏng: Một số công cụ trực tuyến cho phép bạn kiểm tra một URL cụ thể có bị chặn bởi robots.txt không (ví dụ: Google’s robots.txt Tester trong Search Console).

Những lưu ý đặc biệt cho thị trường Việt Nam

- DeepSeek Bot rất quan trọng: Với tỷ lệ sử dụng DeepSeek tại Việt Nam lên tới 38% (theo khảo sát Q1/2026), việc cho phép DeepSeek Bot là ưu tiên hàng đầu. Hãy đảm bảo dòng

User-agent: DeepSeek Botcó trong robots.txt. - Chú ý đến các bot AI từ Trung Quốc: Ngoài DeepSeek, còn có các bot khác như Baiduspider (cho Baidu AI) – nếu bạn nhắm đến thị trường Trung Quốc, có thể cân nhắc cho phép.

- Kết hợp với sitemap đa dạng: Để AI bot hiểu cấu trúc, nên có sitemap riêng cho bài viết, thực thể, sản phẩm. Điều này giúp bot ưu tiên crawl nội dung quan trọng.

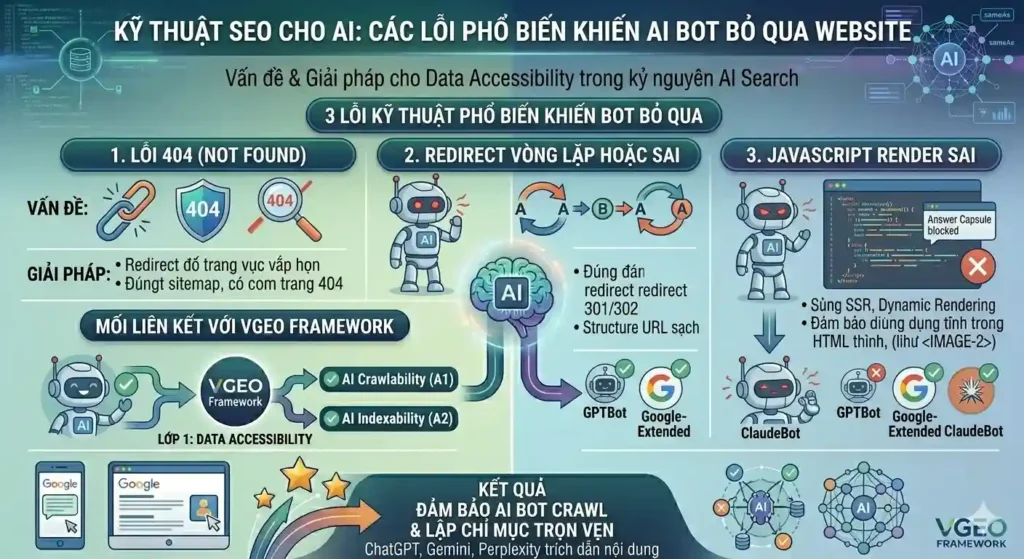

Những sai lầm thường gặp

- Chặn GPTBot vô tình: Nhiều website vẫn còn dòng

Disallow: /cho GPTBot. Hãy kiểm tra lại. - Thiếu Google-Extended: Google có hai bot: Googlebot (dành cho tìm kiếm truyền thống) và Google-Extended (dành cho AI). Nếu chỉ cho phép Googlebot, Gemini sẽ không đọc được nội dung.

- Không khai báo sitemap: Dù không bắt buộc, nhưng sitemap giúp bot khám phá nội dung nhanh hơn.

- Chặn quá nhiều thư mục quan trọng: Đôi khi vô tình chặn cả thư mục chứa nội dung chính. Hãy kiểm tra kỹ trước khi áp dụng.

Kết luận

AI Crawlability là bước nền tảng để website của bạn được các Generative Engine truy cập và đánh giá. Cấu hình robots.txt đúng cách, cho phép các bot AI quan trọng (GPTBot, Google-Extended, ClaudeBot, DeepSeek Bot, PerplexityBot) là việc đầu tiên cần làm khi áp dụng VGEO Framework. Sau khi hoàn tất, hãy kiểm tra và theo dõi log để đảm bảo không có lỗi. Tiếp theo, bạn sẽ chuyển sang các lớp tiếp theo: Content Structuring, Entity & Knowledge Graph, v.v.

Đừng quên kết hợp với các bài viết liên quan như AI Indexability và Structured Data để tối ưu toàn diện.

Câu hỏi thường gặp (FAQ) về AI Crawlability

1. Làm thế nào để biết AI bot đã truy cập website của tôi?

Xem log server (có thể yêu cầu nhà cung cấp hosting cung cấp) hoặc dùng Google Search Console để theo dõi hoạt động của Googlebot và Google-Extended. Một số plugin WordPress cũng hiển thị log truy cập.

2. Có nên chặn một số AI bot để tiết kiệm tài nguyên?

Không nên, trừ khi bạn có lý do đặc biệt (ví dụ: bot gây quá tải). Các bot AI hiện nay thường có cơ chế tôn trọng robots.txt và không gây ảnh hưởng lớn đến hiệu suất. Hãy cho phép tất cả để tối đa cơ hội được trích dẫn.

3. Tôi có cần cấu hình robots.txt riêng cho từng ngôn ngữ?

Không, robots.txt là file toàn cục. Tuy nhiên, nếu bạn có các phiên bản ngôn ngữ khác nhau trên subdomain, mỗi subdomain cần có robots.txt riêng.

4. Nếu tôi chặn GPTBot, liệu ChatGPT có còn biết đến website của tôi không?

ChatGPT có thể vẫn biết đến nếu website được nhắc đến trong các nguồn khác (ví dụ: báo chí, Wikipedia), nhưng cơ hội trích dẫn trực tiếp sẽ giảm đáng kể. Hãy luôn cho phép GPTBot.

5. Có cách nào kiểm tra nhanh xem robots.txt có chặn bot AI không?

Bạn có thể dùng công cụ “robots.txt Tester” của Google Search Console, hoặc một số công cụ trực tuyến khác. Ngoài ra, bạn có thể dùng lệnh curl với user-agent giả lập: curl -A "GPTBot" https://cuonggeo.com để xem phản hồi.

Bài viết thuộc chuyên mục Kỹ thuật GEO của cuonggeo.com – Bản quyền © 2026 Nguyễn Đình Cường.

Cập nhật lần cuối: 24/03/2026.