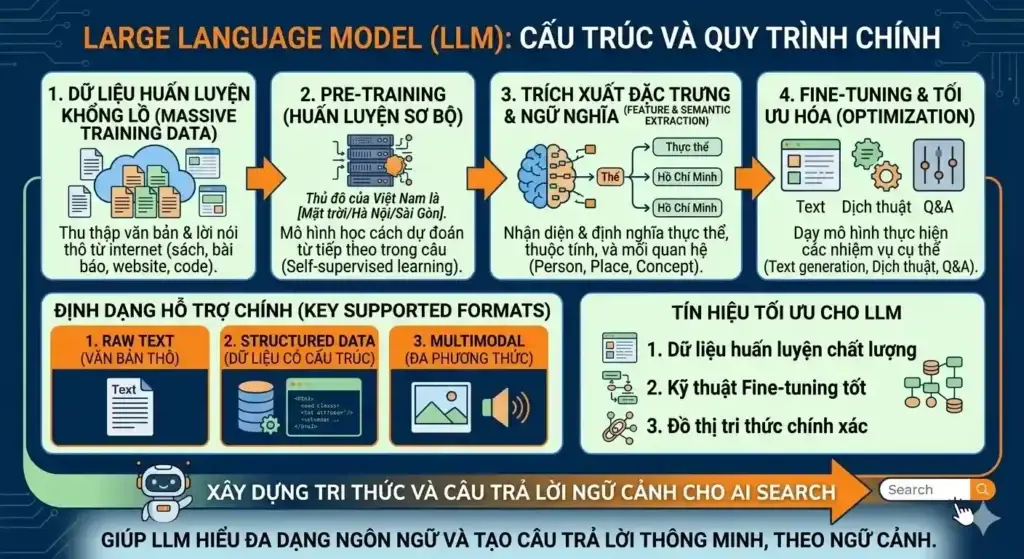

Large Language Model (LLM) hay Mô hình ngôn ngữ lớn là một loại mô hình trí tuệ nhân tạo được huấn luyện trên dữ liệu văn bản khổng lồ, có khả năng hiểu, sinh và tương tác với ngôn ngữ tự nhiên một cách linh hoạt. Các LLM như GPT-4, Gemini, Claude, Llama sử dụng kiến trúc transformer với hàng tỷ tham số, cho phép chúng thực hiện đa dạng tác vụ: trả lời câu hỏi, viết nội dung, dịch thuật, lập trình, và phân tích dữ liệu. Trong VGEO Framework, LLM là “trái tim” của Generative Engine Optimization (GEO), quyết định cách nội dung website được hiểu, đánh giá và trích dẫn trong kỷ nguyên AI Search.

Cấu trúc nội dung

Giới thiệu về Large Language Model

Cuối năm 2022, sự ra mắt của ChatGPT đã tạo ra một cú sốc toàn cầu. Lần đầu tiên, công chúng được trải nghiệm sức mạnh của một mô hình ngôn ngữ lớn (LLM) một cách trực quan: nó có thể trò chuyện tự nhiên, viết bài luận, giải thích khái niệm phức tạp, thậm chí viết code. Đằng sau khả năng đó là một kiến trúc AI tinh vi được huấn luyện trên hàng tỷ văn bản từ internet.

LLM không chỉ là công cụ trò chuyện; chúng đang định hình lại cách con người tìm kiếm và tiếp cận thông tin. Các công cụ tìm kiếm thế hệ mới như Perplexity AI, Google Gemini, và ChatGPT Search dựa hoàn toàn vào LLM để tổng hợp câu trả lời. Điều này đặt ra một yêu cầu mới cho các website: làm thế nào để nội dung của bạn được LLM hiểu và ưu tiên trích dẫn? Đó chính là lúc GEO và VGEO Framework phát huy vai trò.

Large Language Model là gì?

Large Language Model (LLM) là một mô hình học sâu (deep learning) được huấn luyện trên một lượng dữ liệu văn bản cực lớn (hàng nghìn tỷ từ) để hiểu và sinh ra ngôn ngữ tự nhiên. Chúng có khả năng nắm bắt các mẫu hình ngôn ngữ phức tạp, ngữ cảnh, và thậm chí cả kiến thức thực tế từ dữ liệu huấn luyện.

Đặc điểm chính của LLM:

- Kích thước lớn: Hàng tỷ (thậm chí hàng nghìn tỷ) tham số. Ví dụ: GPT-3 có 175 tỷ tham số, GPT-4 ước tính trên 1 nghìn tỷ.

- Kiến trúc Transformer: Sử dụng cơ chế self-attention để xử lý ngữ cảnh hiệu quả.

- Học không giám sát: Học từ dữ liệu thô, không cần gán nhãn thủ công.

- Khả năng tổng quát hóa: Có thể thực hiện nhiều tác vụ mà không cần huấn luyện riêng (zero-shot, few-shot learning).

📌 CÁCH LLM HOẠT ĐỘNG

1. Tokenization: Văn bản được chia thành các token (từ hoặc cụm từ).

2. Embedding: Mỗi token được chuyển thành vector số trong không gian đa chiều.

3. Transformer layers: Các lớp mạng nơ-ron xử lý mối quan hệ giữa các token.

4. Attention mechanism: Mô hình “chú ý” đến các token quan trọng nhất trong ngữ cảnh.

5. Generation: Dự đoán token tiếp theo dựa trên xác suất, tạo thành câu trả lời.

Lịch sử phát triển của LLM

- 2017: Google giới thiệu kiến trúc Transformer trong bài báo “Attention Is All You Need” – nền tảng của mọi LLM hiện đại.

- 2018: OpenAI ra mắt GPT-1 (117 triệu tham số), khởi đầu cho dòng GPT.

- 2019: GPT-2 (1.5 tỷ tham số) gây chú ý với khả năng sinh văn bản mạch lạc.

- 2020: GPT-3 (175 tỷ tham số) đánh dấu bước ngoặt, cho thấy tiềm năng của LLM.

- 2022: ChatGPT (dựa trên GPT-3.5) ra mắt, đạt 100 triệu người dùng sau 2 tháng.

- 2023-2024: Hàng loạt mô hình mạnh mẽ ra đời: GPT-4, Gemini, Claude, Llama 2/3, Mistral, DeepSeek.

- 2025-nay: LLM đa phương thức (xử lý văn bản, hình ảnh, video, âm thanh) trở thành xu hướng chính.

Các LLM phổ biến hiện nay

Ứng dụng của LLM trong đời sống và công nghệ

- Trợ lý ảo và Chatbot: ChatGPT, Gemini, Claude – hỗ trợ trò chuyện, giải đáp thắc mắc.

- Tìm kiếm thông minh: Perplexity AI, Google Search Generative Experience – tổng hợp câu trả lời từ nhiều nguồn.

- Viết nội dung: Tạo bài báo, email, kịch bản, quảng cáo.

- Lập trình: GitHub Copilot, Codeium – gợi ý code, debug, giải thích thuật toán.

- Dịch thuật: Dịch văn bản với chất lượng ngày càng cao.

- Phân tích dữ liệu: Trích xuất thông tin từ văn bản, phân tích cảm xúc, tóm tắt tài liệu.

- Giáo dục: Gia sư AI, giải thích khái niệm, tạo bài tập.

- Y tế: Hỗ trợ chẩn đoán, tóm tắt hồ sơ bệnh án.

LLM và Generative Engine Optimization (GEO)

1. LLM là trái tim của GEO

Generative Engine Optimization (GEO) là tập hợp các kỹ thuật tối ưu nội dung để các LLM có thể hiểu, tin tưởng và trích dẫn. Nếu không có LLM, GEO không tồn tại. LLM quyết định:

- Nội dung nào được chọn làm nguồn trả lời.

- Thứ tự ưu tiên của các nguồn.

- Cách thông tin được tổng hợp và trình bày.

2. LLM đánh giá nội dung thế nào?

- Độ liên quan ngữ nghĩa: So sánh vector embeddings của câu hỏi và nội dung.

- Uy tín nguồn: Dựa trên các tín hiệu như tác giả chuyên gia, trang web uy tín, trích dẫn đa nguồn.

- Tính mới mẻ: Nội dung cập nhật gần đây được ưu tiên.

- Cấu trúc và rõ ràng: Nội dung có Answer Capsule, heading, danh sách, bảng biểu dễ hiểu hơn.

- Sự nhất quán của thực thể: Các thực thể được định nghĩa rõ, liên kết với nhau.

3. LLM và Knowledge Graph

LLM thường kết hợp với Knowledge Graph để tăng độ chính xác. Knowledge Graph cung cấp các sự kiện và mối quan hệ đã được xác thực, giúp LLM giảm “ảo giác” (hallucination). Trong VGEO Framework, việc xây dựng thực thể và kết nối với Wikidata là cách để website tham gia vào Knowledge Graph toàn cầu.

📌 VGEO Framework và LLM

Trong VGEO Framework, LLM ảnh hưởng trực tiếp đến:

- Lớp 2 (Content Structuring): Cách tổ chức nội dung để LLM dễ hiểu (Answer Capsules, heading, schema).

- Lớp 3 (Entity & Knowledge Graph): Xây dựng thực thể giúp LLM nhận diện và liên kết thông tin.

- Lớp 4 (Authority): Tín hiệu uy tín giúp LLM đánh giá độ tin cậy.

- Lớp 5 (Information Distribution): Sự hiện diện đa nền tảng tạo “đồng thuận” cho LLM.

LLM và tiếng Việt: Thách thức và cơ hội

Thách thức

- Dữ liệu huấn luyện hạn chế: Hầu hết LLM được huấn luyện trên dữ liệu tiếng Anh (chiếm 80-90%). Dữ liệu tiếng Việt chất lượng cao còn ít, ảnh hưởng đến độ chính xác.

- Đặc thù ngôn ngữ: Thanh điệu, từ đa nghĩa, phương ngữ gây khó khăn cho LLM. Ví dụ: “bát” (miền Bắc) và “chén” (miền Nam) cùng một thực thể nhưng tên gọi khác nhau.

- Ít mô hình chuyên biệt: Dù có PhoGPT, ViBERT, nhưng chúng chưa đủ mạnh bằng các mô hình quốc tế.

Cơ hội

- Nhu cầu lớn: 81% người Việt tương tác AI hàng ngày, tạo ra thị trường khổng lồ cho nội dung tiếng Việt chất lượng cao.

- Khoảng trống thông tin: Các website tiếng Việt được tối ưu tốt sẽ dễ dàng trở thành nguồn trích dẫn hàng đầu.

- Phát triển mô hình nội địa: Các dự án như PhoGPT, ViGPT đang cải thiện, mở ra cơ hội hợp tác.

📌 TỐI ƯU CHO LLM TIẾNG VIỆT

– Sử dụng Answer Capsules để định nghĩa rõ thực thể ngay từ đầu.

– Cung cấp alternateName trong schema cho các biến thể ngôn ngữ (ví dụ: “bát”, “chén”).

– Viết nội dung rõ ràng, mạch lạc, tránh mơ hồ.

– Liên kết nội bộ giữa các thực thể giúp LLM xây dựng mối quan hệ.

– Sử dụng Structured Data đầy đủ.

LLM và tương lai của SEO

SEO truyền thống đang thay đổi sâu sắc dưới tác động của LLM:

- Zero-click search: 60% lượt tìm kiếm kết thúc không nhấp chuột. Người dùng nhận câu trả lời trực tiếp từ LLM.

- Từ keyword đến entity: Tối ưu từ khóa đơn lẻ không còn đủ. Cần tối ưu thực thể và ngữ cảnh.

- Uy tín (Authority) lên ngôi: LLM ưu tiên các nguồn đáng tin cậy, có tác giả chuyên gia.

- Nội dung chất lượng cao được thưởng: LLM có thể phát hiện nội dung sâu sắc, có nghiên cứu và ưu tiên trích dẫn.

Thực hành: Tối ưu nội dung cho LLM trên cuonggeo.com

Website của chúng ta đã áp dụng nhiều nguyên tắc thân thiện với LLM:

- Hệ thống thực thể: Mỗi khái niệm quan trọng đều có trang riêng với nội dung chuyên sâu, được liên kết với nhau.

- Answer Capsules: Đầu mỗi bài là đoạn trả lời ngắn, định nghĩa rõ thực thể.

- Cấu trúc rõ ràng: Heading phân cấp, danh sách, bảng biểu.

- Schema đầy đủ: Article, Person, Organization, FAQPage được triển khai qua WPCode.

- Liên kết nội bộ: Mạng lưới liên kết giữa các thực thể giúp LLM hiểu mối quan hệ.

- Uy tín tác giả: Hồ sơ tác giả chuyên nghiệp với

sameAsđầy đủ.

“LLM không chỉ là công cụ tìm kiếm, mà là một ‘sinh viên’ thông minh đang đọc toàn bộ internet. Nó ưu tiên những nguồn rõ ràng, đáng tin cậy, và có cấu trúc tốt. Hãy viết cho LLM cũng như viết cho một đồng nghiệp thông thái.”

— Nguyễn Đình Cường, tác giả VGEO Framework

Kết luận

Large Language Model (LLM) đang định hình lại toàn bộ hệ sinh thái thông tin. Từ cách chúng ta tìm kiếm, đến cách chúng ta viết nội dung, và cách thương hiệu được nhìn nhận. Trong VGEO Framework, hiểu và tối ưu cho LLM là yêu cầu sống còn. Bằng cách xây dựng nội dung chất lượng, cấu trúc rõ ràng, và tín hiệu uy tín mạnh mẽ, bạn không chỉ giúp website thân thiện với LLM, mà còn xây dựng nền tảng vững chắc cho tương lai của thương hiệu trong kỷ nguyên AI.

Hãy tiếp tục khám phá các thực thể liên quan: Generative Engine Optimization (GEO), Knowledge Graph, Natural Language Processing (NLP), và VGEO Framework.

Câu hỏi thường gặp (FAQ) về Large Language Model

1. LLM có thực sự hiểu ngôn ngữ không, hay chỉ bắt chước?

LLM không hiểu theo cách con người hiểu, nhưng thông qua việc học từ lượng dữ liệu khổng lồ, chúng nắm bắt được các mẫu hình ngôn ngữ phức tạp và có thể sinh ra câu trả lời chính xác, mạch lạc. Mức độ “hiểu” của LLM đang là chủ đề tranh luận, nhưng không thể phủ nhận khả năng ứng dụng thực tế của chúng.

2. Làm thế nào để LLM không bị “ảo giác” (hallucination)?

Ảo giác là khi LLM tạo ra thông tin sai sự thật. Để giảm thiểu, có thể kết hợp LLM với cơ chế truy xuất thông tin (RAG), sử dụng Knowledge Graph, và tinh chỉnh mô hình trên dữ liệu chất lượng cao. Người dùng cũng nên kiểm chéo thông tin từ nhiều nguồn.

3. LLM có thay thế được công cụ tìm kiếm truyền thống không?

Có thể trong tương lai gần. Hiện tại, các công cụ như Perplexity AI, Google Gemini đã tích hợp LLM vào tìm kiếm. Tuy nhiên, tìm kiếm truyền thống vẫn có vai trò nhất định, đặc biệt cho các nhu cầu khám phá thông tin tổng quát.

4. Tôi có thể tự xây dựng LLM cho riêng mình không?

Có thể với các mô hình mã nguồn mở như Llama, Mistral. Bạn cần có kiến thức về machine learning, tài nguyên tính toán lớn (GPU), và dữ liệu huấn luyện phù hợp. Tuy nhiên, với hầu hết doanh nghiệp, việc sử dụng API từ các nhà cung cấp (OpenAI, Google, Anthropic) là thiết thực hơn.

5. LLM ảnh hưởng thế nào đến chiến lược nội dung?

Chiến lược nội dung cần chuyển từ tối ưu từ khóa sang tối ưu thực thể và ngữ cảnh. Cần xây dựng nội dung chuyên sâu, có cấu trúc rõ ràng, và đặc biệt chú trọng đến uy tín (tác giả, nguồn trích dẫn). Các khái niệm như Answer Capsule, Entity Optimization, Topical Authority trở nên quan trọng.

Bài viết thuộc hệ thống thực thể của VGEO Framework – Bản quyền © 2026 Nguyễn Đình Cường.

Cập nhật lần cuối: 18/03/2026.